LLM в разработке: кейсы и практические сценарии применения

В предыдущей статье мы выяснили, что работа программистов постепенно смещается от ручного написания кода к формулированию задач и проверке результата. Теперь посмотрим, где именно языковые модели приносят реальную пользу — на примере крупных технологических компаний.

В этой статье собраны технические кейсы внедрения LLM в разработке и список задач, где эффект измерим в сроках и качестве.

Если нужен общий вход в тему LLM, а не только инженерные кейсы разработки, начните с главного хаба по языковым моделям.

Главное

LLM дают максимальный эффект в задачах с быстрым контуром проверки результата: тесты, миграции, рефакторинг, документация, генерация типового кода.

Стабильность появляется при процессе контроля: pull request, ревью, тесты, чек-лист приёма работ.

Лучшие первые задачи для внедрения: автотесты, генерация вспомогательного кода, миграции, нормализация инфраструктурных скриптов, подготовка документации.

Ожидаемый результат пилота: ускорение типовых задач, сокращение ручной рутины, рост покрытия тестами, снижение времени на поддержку.

Какие задачи в разработке лучше всего подходят для LLM

Работа с кодом

- генерация заготовок и шаблонов кода

- ускорение написания типовых функций

- рефакторинг и приведение кода к единому стилю

- массовое обновление API и библиотек

- поиск и исправление простых ошибок

Миграции и легаси

- перевод кода на новые версии фреймворков

- обновление тестов при смене инструментов

- автоматизация однотипных правок в тысячах файлов

- помощь в разборе старого и плохо документированного кода

Тестирование

- генерация автотестов

- обновление существующих тестов

- объяснение, что именно проверяет тест

- поиск дублирующихся или устаревших проверок

Документация и сопровождение

- генерация технической документации

- пояснение сложных участков кода простым языком

- подготовка комментариев и описаний изменений

- помощь при онбординге новых разработчиков

Инфраструктура и DevOps

- написание и правка конфигураций (CI/CD, Terraform и аналоги)

- генерация шаблонов инфраструктурного кода

- помощь в диагностике ошибок сборки и деплоя

Повседневная инженерная работа

- ускорение подготовки изменений к ревью

- помощь в навигации по большим репозиториям

- снижение количества мелких ручных правок

Что показывают кейсы крупных компаний

Google: в 2 раза быстрее массовые миграции кода на десятках тысяч строк

Google развивает тысячи сервисов и внутренних библиотек. Их код постоянно приходится обновлять: менять API, переходить на новые версии инструментов, поддерживать совместимость между командами.

В чём была проблема

Когда нужно обновить сразу тысячи файлов, задача превращается в дорогостоящий и рискованный процесс. Ошибка в массовом обновлении может затронуть пользователей, а ручная работа занимает месяцы.

Что делал ИИ

Языковую модель встроили в инженерный конвейер. Сначала автоматические правила находили места, где нужен апдейт. Затем LLM генерировала однотипные правки по шаблону и применяла их ко всей кодовой базе. Инженеры проверяли результат и исправляли редкие сложные случаи.

Проще говоря, ИИ взял на себя механическую часть работы, которая раньше выполнялась вручную сотнями повторяющихся действий.

Что получилось в итоге

За три месяца команда обновила более 5 300 файлов и изменила около 149 000 строк кода. Большая часть правок была принята без изменений. По оценке инженеров, такие миграции стали занимать примерно в два раза меньше времени, чем раньше.

Airbnb: миграция 3 500 тестов за 6 недель вместо 1,5 лет

Airbnb — крупная платформа бронирования жилья. Продукт активно развивается, и стабильность интерфейса для них критична.

В чём была проблема

Компания решила обновить систему автоматических тестов фронтенда. Нужно было переписать почти 3 500 файлов тестов. Если бы это делали вручную, команда оценила задачу примерно в полтора года работы.

Что делал ИИ

Команда построила автоматический процесс, в котором LLM переписывала тесты по заданным правилам. Для сложных случаев модель запускали повторно с уточнённым контекстом. Инженеры подключались только там, где автоматизация не справлялась.

ИИ не принимал решений за людей, но сильно сократил объём рутинной работы.

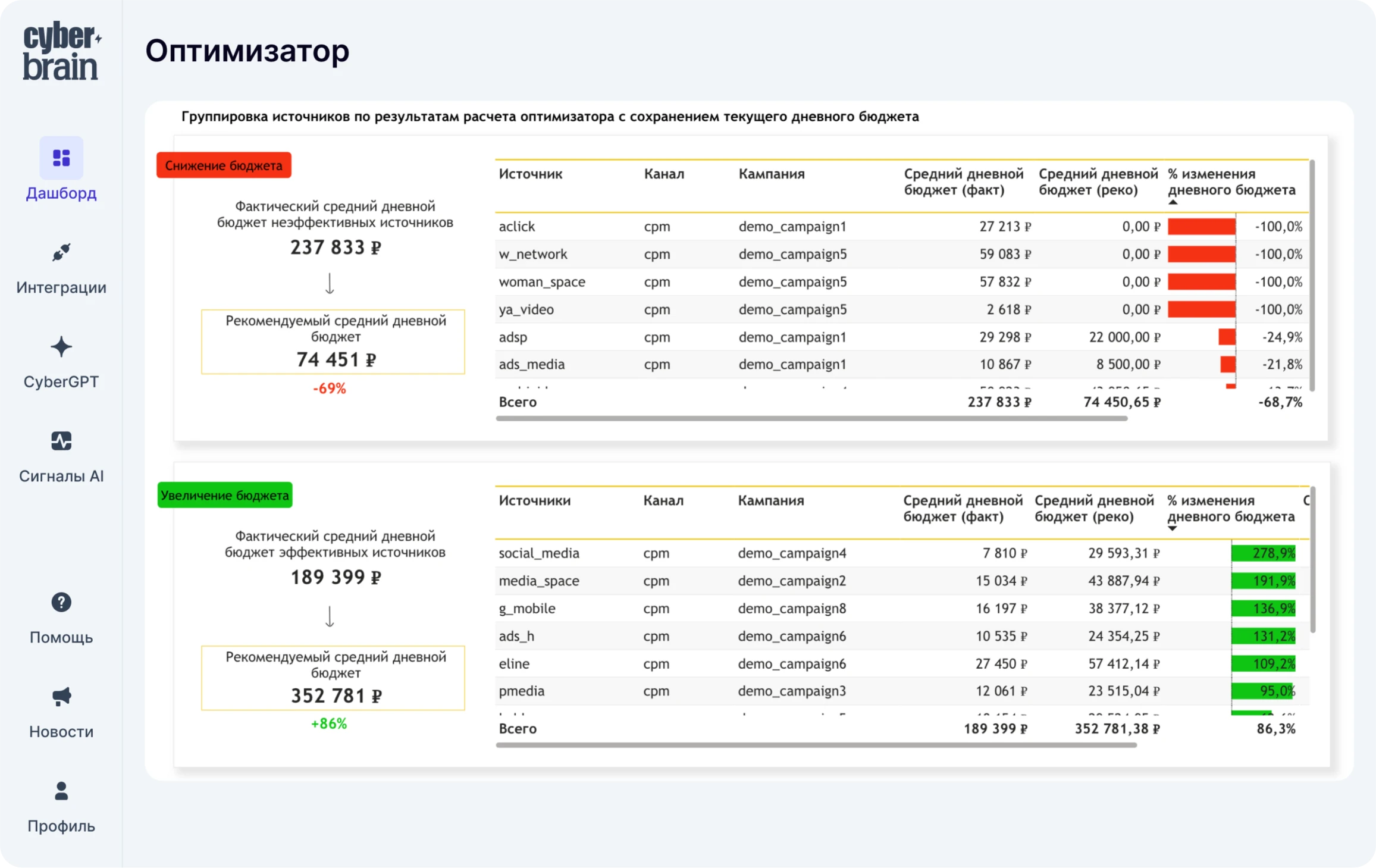

Запись на демо продукта

CEO CyberBrain расскажет о платформе и предложит лучшее решение ваших задач

Что получилось в итоге

Вся миграция заняла 6 недель вместо полутора лет. Продукт продолжал развиваться параллельно, без заморозки релизов и без роста нагрузки на команду.

Mercado Libre: код пишется в два раза быстрее в масштабе тысяч разработчиков

Mercado Libre — крупнейшая e-commerce-платформа в Латинской Америке с тысячами инженеров.

В чём была проблема

Ручная работа с типовым кодом отнимала слишком много времени.

Что делал ИИ

Для повседневных задач стали использовать Copilot: шаблонный код, стандартные конструкции, небольшие правки.

Что получилось в итоге

Разработчики стали тратить примерно в два раза меньше времени на написание кода. В компании Copilot используют более 9 000 инженеров, а объём ежедневных изменений измеряется десятками тысяч правок.

Что ещё показывают эксперименты с LLM в разработке

Amazon (AWS): +57% к скорости решения задач

Amazon — одна из крупнейших технологических компаний мира. Помимо e-commerce, она развивает AWS — облачную платформу, на которой работает огромное количество сервисов и приложений по всему миру.

Amazon проверила эффект ИИ-ассистента в формате практического эксперимента: разработчикам давали реальные задачи, а собственный инструмент компании, CodeWhisperer, помогал им прямо в редакторе кода — подсказывал заготовки, дополнял типовые фрагменты и снижал объём ручной работы.

В результате участники с ИИ выполняли задачи в среднем на 57% быстрее и на 27% чаще доводили их до корректного результата.

Microsoft: +26% к объёму готовых изменений

Microsoft провела эксперимент на 4 867 разработчиках, измеряя фактический объём выполненной работы. Разработчики с GitHub Copilot стали оформлять и доводить до стадии «готово к принятию» примерно на 26% больше изменений в ходе обычной работы.

В итоге команды начали выпускать больше улучшений за то же время без переработок и увеличения штата.

Что общего у рабочих кейсов LLM в разработке

Во всех описанных примерах языковые модели не заменяют разработчиков и не принимают решения самостоятельно. Они ускоряют подготовку решений, снижают объём механической работы и помогают ориентироваться в сложных системах.

Как внедрять LLM в разработку и как проверять результат

| Сценарий | Что делает LLM | Как проверять | Что подготовить |

|---|---|---|---|

| Автотесты | Генерирует тесты по существующему коду и требованиям | Автопрогон тестов, проверка покрытия, ревью тестов | Требования к тестам, структура проекта, примеры существующих тестов |

| Миграции и массовые правки | Готовит патчи и обновления по шаблону, помогает с повторяющимися изменениями | Сборка, тесты, выборочная проверка изменений | Правила миграции, ограничения по файлам, список затронутых модулей |

| Рефакторинг и улучшение читаемости | Предлагает упрощения, вынос повторяющегося кода, улучшение именований | Тесты, статический анализ, ревью | Код-стайл, запреты на изменения публичных контрактов |

| Документация и технические описания | Формирует документацию по коду, описывает API, обновляет README | Сверка с реальным интерфейсом и примерами | Актуальные спецификации и примеры вызовов |

| Поддержка и разбор инцидентов | Помогает структурировать диагностику, собрать чек-лист проверок, подготовить postmortem | Подтверждение фактами из логов и метрик | Доступные данные наблюдаемости и формат отчётов |

Какие правила внедрения LLM в разработке работают лучше всего

- Давать модели задачи с ограниченным контекстом и ясным форматом результата.

- Фиксировать критерии контроля для каждого типа задачи: тесты, миграции, документация.

- Принимать изменения через pull request и ревью.

- Держать личную информацию вне промптов, исключать чувствительные данные из контекста.

- Использовать автотесты и статический анализ для проверки результата.

Ответы на вопросы

Что такое LLM и как они используются в разработке программного обеспечения

LLM (большие языковые модели) — это ИИ-модели, которые умеют работать с текстом и кодом. В разработке их используют как помощников: они ускоряют написание кода, помогают обновлять старые системы, писать тесты, разбираться в чужом коде и снижать объём рутинной работы.

Заменяют ли LLM разработчиков

Нет. Во всех реальных кейсах LLM не принимают решений самостоятельно. Они выполняют вспомогательные задачи, а архитектура, логика и ответственность за результат остаются у людей.

Какие задачи LLM решают лучше всего и где дают самый быстрый эффект

Лучше всего модели справляются с типовыми и повторяющимися задачами: массовые изменения кода, заготовки, обновление тестов, шаблонные правки, помощь с документацией и разбором больших кодовых баз.

Есть ли измеримый эффект от использования LLM

Да, эффект измеряют в конкретных метриках: скорость выполнения задач, объём готовых изменений, время ревью, длительность миграций, частота релизов. В кейсах это даёт ускорение от десятков процентов до кратных сокращений сроков.

Безопасно ли использовать LLM в коммерческой разработке

При правильной интеграции — да. Компании используют LLM внутри существующих процессов с тестами, ревью и проверками. ИИ не отправляет код напрямую в продакшен и не заменяет контроль качества.

Подходят ли LLM только большим компаниям

Нет. Просто у крупных компаний эффект заметнее из-за масштаба. Те же сценарии работают и в средних командах: меньше времени на рутину, быстрее изменения, проще поддержка легаси-кода.

С чего начать внедрение LLM в небольшой команде

Обычно начинают с простых сценариев: помощник в IDE, генерация заготовок, работа с тестами или документацией.

Вывод

Эффект от внедрения появляется там, где использование ИИ:

- встроено в существующие процессы

- сопровождается проверкой результата

- измеряется через конкретные метрики

Практика показывает, что LLM уже используются как рабочий инструмент в разработке программного обеспечения. Они ускоряют массовые изменения кода, обновление тестов, подготовку правок и прохождение ревью.

Эффект от внедрения LLM измеряется конкретными показателями: сокращением сроков миграций, ростом скорости выполнения задач и увеличением объёма готовых изменений. Наибольшую пользу языковые модели приносят в тех случаях, где они встроены в существующие инженерные процессы и применяются для снижения объёма рутинной работы при сохранении контроля качества.

Запись на демо продукта

CEO CyberBrain расскажет о платформе и предложит лучшее решение ваших задач